После серии резонансных дел с дипфейками, в ходе которых Midjourney стал платным, как никогда актуализировался вопрос: как отличить фотографии, созданные искусственным интеллектом, от реальных?

Настоящее фото, или сгенерированное искусственным интеллектом: распознаем подделку

За последние несколько лет развитие искусственного интеллекта превзошло любые ожидания. Сначала для пользователей открылись автоматические ответы в чат-ботах, далее машина начала заменять операторов колл-центров.

Теперь очередь дошла до фотографий, которые искусственный разум научился генерировать с невероятной реалистичностью. Изображения, созданные AI, почти не отличаются от настоящих. Однако существует несколько моментов, с помощью которых можно увидеть разницу. Далее поговорим об этом более подробно и покажем, как быстро распознать фото, сгенерированные искусственным интеллектом.

Искусственный «фотограф»: как это работает?

Мы всегда что-то рисуем в своем воображении. Теперь эти картинки достаточно просто материализовать. Для этого понадобится доступ к всемирной паутине и инструменты ИИ. Для наиболее популярных нейросетей Midjourney, DALL-E или DeepAI создать реалистичное изображение или фантастическую картинку — простая задача.

Расширяйте знания: Альтернатива Midjourney: 3 бесплатные нейросети, рисующие по запросу

ИИ может самостоятельно продуцировать абсолютно уникальный контент или трансформировать уже существующий. Нейросеть способна менять цвета и форму изображенных предметов, переставлять объекты, убирать лишние или добавлять новые. Кроме этого AI может выполнить имеющуюся картинку в совершенно другом стиле или жанре. И это еще не все возможности.

В большинстве случаев «услуги» нейросети — бесплатные, или это стоит относительно недорого. Благодаря такой доступности интернет-пространство заполонили сотни различных изображений. Людям многих профессий, таких как маркетологи, копирайтеры, дизайнеры, ИИ пригодился. Он облегчил работу и освободил много времени для чего-то другого. Вместе с тем, нейросеть начали использовать с плохими намерениями. Например, для пропаганды и дезинформации.

Злые шутки нейросети

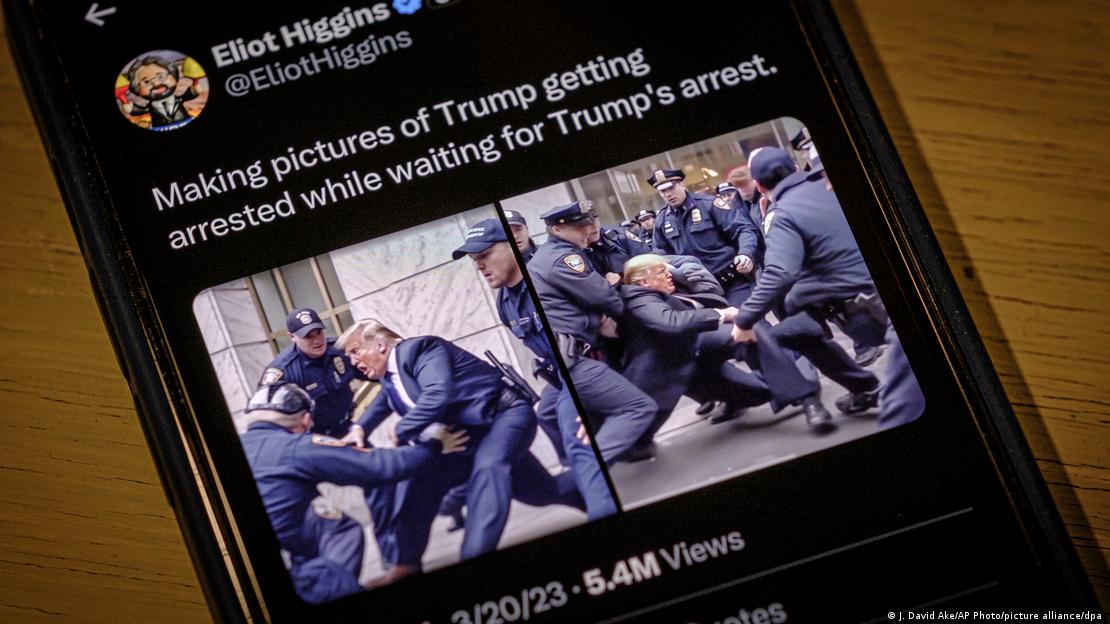

Скриншот сгенерированной с помощью ИИ фотографии Дональда Трампа Фото: J. David Ake/AP Photo/picture alliance/dpa

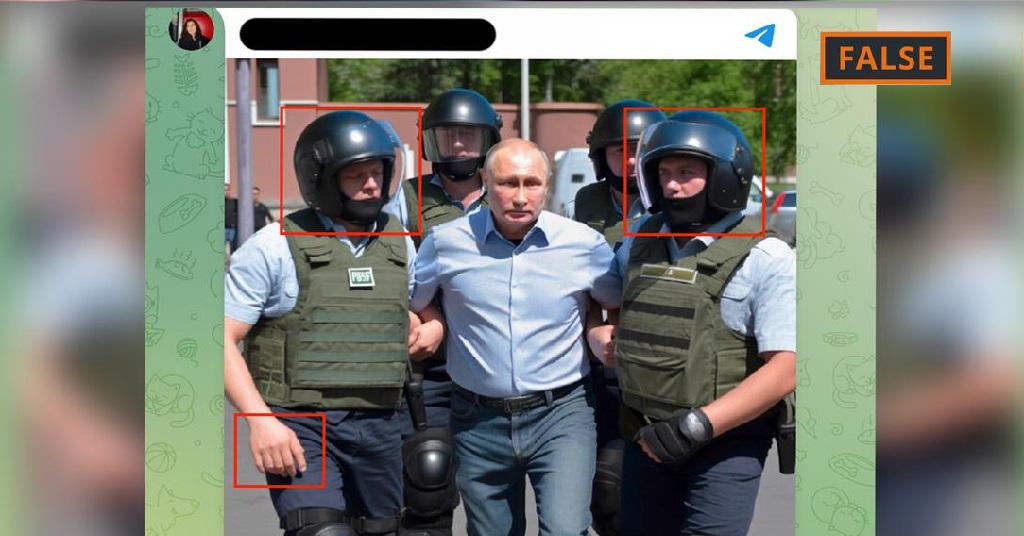

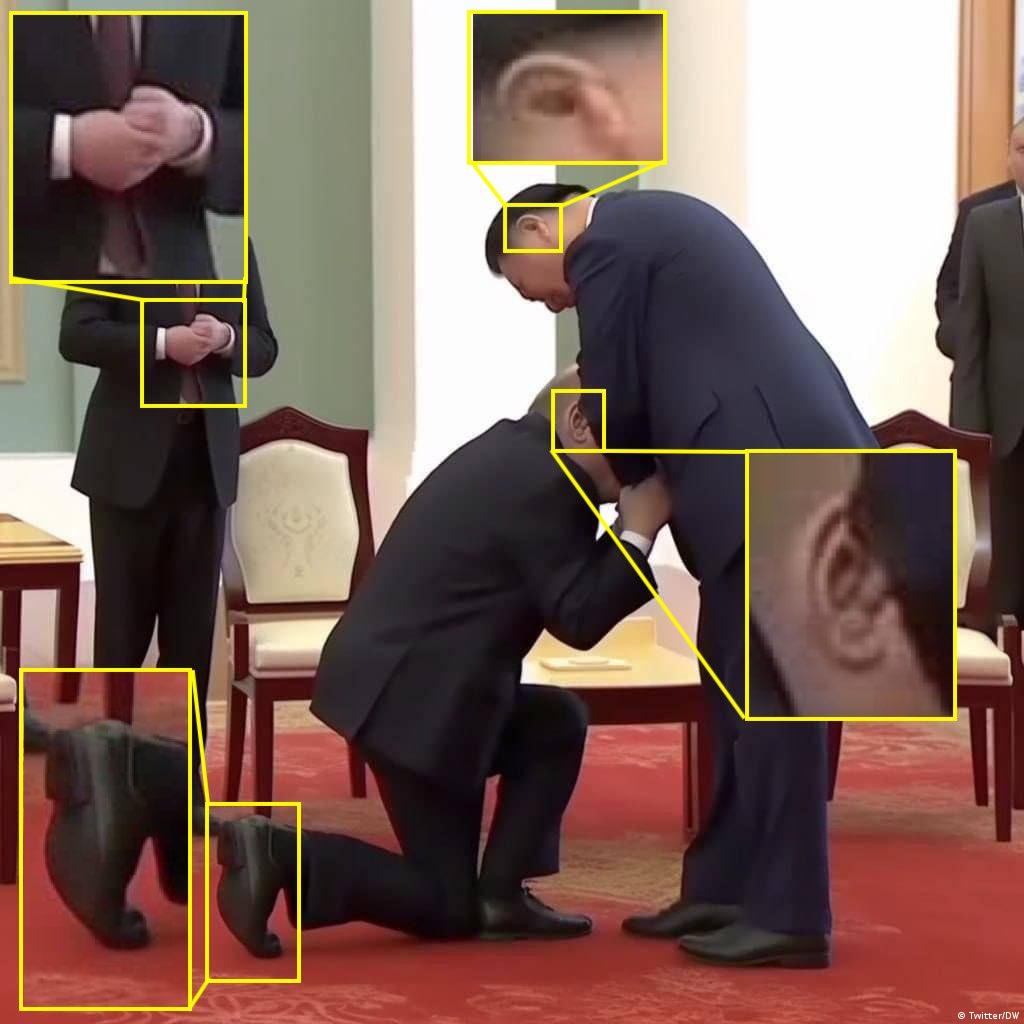

В последние месяцы интернет особенно пестрит снимками, автор которых — искусственный интеллект. Наибольшую шумиху наделали несколько фотографий. На первой изображен якобы владимир путин, который стал на колено перед главой Китая Си Цзиньпином и в таком положении целует ему руку. На другой видим якобы Дональда Трампа в тесном кольце полицейских во время его якобы ареста. Кстати, существует фото с такой же тематикой с участием российского президента.

ИИ не обошел вниманием даже Папу Римского. В сети «гуляет» изображение, на котором Понтифик якобы одет в модный пуховик белого цвета. Над Илоном Маском нейросеть пошутила, изобразив его рядом с самой заклятой конкуренткой — генеральным директором General Motors. На фотографии якобы Илон Маск прогуливается по городу с Мэри Барру, мило держась за руки.

Интересное по теме: Искусственный интеллект Midjourney может заменить художников — обновление нейросети

Скриншот сгенерированной с помощью ИИ фотографии Илона и Мэри

Все эти изображения выглядят очень реалистичными, если иметь в виду именно техническое исполнение. При этом событий, которые они демонстрируют, никогда не было в реальности. Поэтому напрашивается потрясающий вывод — искусственный интеллект начинает стирать грань между реальностью и вымыслом. И чем дальше, тем больше он совершенствуется.

Воображаемые землетрясения и природные катаклизмы

Когда дело касается фотографий каких-то выдающихся событий, таких как автогонки, космические полеты или громкие аресты известных людей, проверить подлинность достаточно просто. Пользователь должен обратиться к авторитетным изданиям массовой информации или другим интернет-ресурсам, заслуживающим доверия, и поискать там подтверждение события.

Однако, когда дело касается не слишком известных личностей, о которых не будут писать везде, распространять дезинформацию становится значительно проще. Об этом рассказал эксперт по нейронным сетям Генри Эйдер в последнем интервью. С его слов, вымышленные события могут касаться не только конкретных личностей, но и природных явлений.

Например, Эйдер знаком с человеком, который создал фотографию землетрясения, которого на самом деле никогда не было. Речь идет о фотографии якобы мощного землетрясения в Тихом океане в 2001 году. Размещенная на англоязычном ресурсе Reddit фотография была создана с помощью нейросети.

Здесь возникает закономерный вопрос: «А как отличить настоящие фото от созданных ИИ?» Сейчас существуют критерии, которые показывают разницу. Несмотря на быстрое развитие нейронных сетей, они все еще допускают много ошибок. Далее предлагаем несколько советов, чтобы не попасться на крючок манипуляции.

Максимально увеличить изображение для тщательного изучения деталей

Большинство фотографий, созданных нейросетью, выглядят очень реалистично. Однако при увеличении масштаба возможно разглядеть странные детали. Для этого нужно скачать фото в максимально высоком качестве. Например, становятся заметными несостыковки линий, несоответствие теней, несовпадение цветов, клоны деталей и т.д.

Читайте актуальное: Как искусственный интеллект меняет ход выборов в США в 2024 году

Найдите первоисточник

Первый способ проверить правдива ли информация перед вами — найти ее подтверждение на других платформах. Это правило работает и с изображениями также. Если есть сомнения относительно реалистичности фотографии, поищите ее первоисточник. Поиск можно начать с прочтения комментариев. Часто там происходят оживленные обсуждения, в которых можно наткнуться на первую публикацию фото.

Другой способ найти источник картинки — использовать обратный поиск. Для этого загрузите фотографию в один из соответствующих инструментов, например, Google или TіnEye. После анализа изображения получите дополнительную информацию о нем, а возможно и данные о его происхождении. Если авторитетные ресурсы уже провели фактчекинг, поисковик выдаст его результаты.

Особое внимание на пропорциональность объектов

Чаще всего ИИ ошибается именно в изображении пропорций тела, присутствующих на фото людей. Слишком маленькие руки со слишком длинными пальцами, или наоборот слишком большие руки — это признаки созданного нейросетью изображения. Также часто на дезинформирующих снимках встречаются несоответствия размеров головы и туловища.

Например, на сгенерированной фотографии путина и Си Цзиньпина ботинок, расположенный сзади, слишком большой и широкий. Та же нога кажется будто растянутой. А голова непропорционально большая по отношению к телу.

Скриншот сгенерированной с помощью ИИ фотографии путина и Си Фото: Twitter/DW

Интересное по теме: Slack анонсировал запуск мессенджера на основе искусственного интеллекта

Запомните и замечайте типичные ошибки нейросети

На сегодня программы с искусственным интеллектом не научились изображать пропорционально правильное тело человека. Особенно проблема у ИИ с руками. Очень часто нейросети дорисовывают шестой палец или, наоборот, убирают пятый. Это ярко иллюстрируют изображения российского диктатора, якобы во время ареста, где у одного из полицейских (тот, что слева от президента) отсутствует один палец. На сгенерированной фотографии Папы Римского в пуховике одна рука тоже только с четырьмя пальцами.

Очень часто у вымышленных персон оказывается слишком много зубов, неестественной формы уши, нос или глаза. Чтобы маскировать недостатки, AI нередко надевает людям очки. Но они сидят неестественно и выглядят странно. Также проблемы для реалистичности изображений ИИ добавляют отражения в окнах или других глянцевых поверхностях.

Доверяйте собственной интуиции

Искусственный интеллект стремится к совершенству. Иногда это играет ему не на руку, ведь созданные им изображения выглядят слишком идеальными, а потому неестественными. Поэтому, советуем доверять собственному чутью: возможно ли, чтобы реальная фотография была такой безупречной? Когда речь идет о портретных фотографиях, недоверие может вызвать слишком гладкая кожа, без намека на неровность тона. Подозрительные, слишком идеальные зубы и волосы.

Безупречные люди на безупречном фоне — явный признак фальшивки. Такого результата невозможно достичь с идеальными моделями и профессиональными фотографами, даже после обработки. Но нейросеть создает изображения, которые должны понравиться всем.

Обратите внимание: Крупнейший фотобанк подал в суд на ИИ за кражу изображений: подробности

Обратите внимание на фон

Чтобы обнаружить фотографию, созданную ИИ, стоит внимательно присмотреться к заднему фону. Часто объекты на фоне искажаются: фонари искривляются, деревья вытягиваются. Также AI «любит» клонировать людей или предметы. Поэтому на одном изображении можно найти немало близнецов.

Несмотря на все вышеупомянутое следует понимать, что ИИ постоянно учится, а значит вскоре перечисленные ошибки сойдут на нет. Совершенствование технологий снизит в разы эффективность работы детекторов, таких как Hugging Face. Подобные программы не могут выявлять фальшивки. Их максимум — давать подсказки и на том все.

Полагаться полностью на детекторы не советуют эксперты, ведь программы тоже ошибаются и в результате настоящие фотографии объявляются дезинформацией, а фейки — реальными фотографиями. Напрашивается неутешительный вывод — пора привыкать к мысли, что нельзя доверять ни одному изображению в сети интернет.

Популярные материалы по теме:

В ЕС создали аналитический центр для выявления опасностей искусственного интеллекта

В поиске Google появятся видео из TikTok и возможность общения с ИИ

Искусственный интеллект научился трансформировать видео: Runway выпустил Gen-1

Telegram

Telegram

Viber

Viber